L'association Human Rights Watch tente d'alerter les gouvernements sur ce point en les appelant à "conserver un contrôle humain significatif sur les systèmes d'armement et interdire les armes totalement autonomes", en association avec le Laboratoire des droits humains internationaux de la Faculté de droit de l'Université de Harvard.

Cette idée du "contrôle humain significatif" doit donc faire l'objet de délibérations cette semaine au sein de l'ONU et elle est portée par un rapport discutant de la nécessité "que les humains gardent le contrôle sur les fonctions cruciales de la sélection des cibles et du moment de l'attaque".

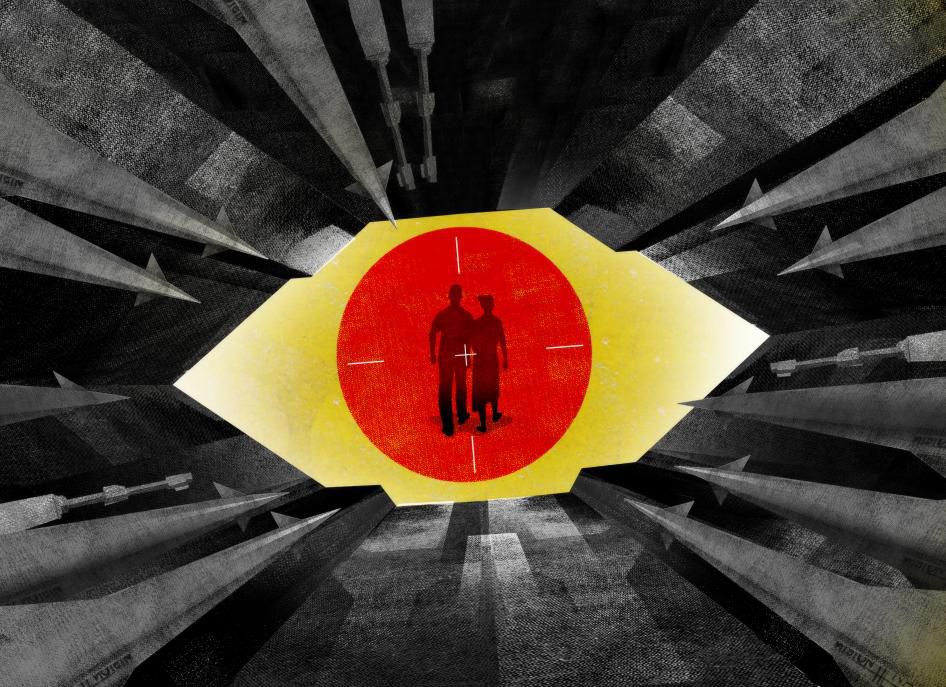

Faut-il laisser aux robots tueurs "des décisions de vie ou de mort" ? C'est dans le droit international que Human Rights Watch et le laboratoire de Harvard cherchent des sources d'inspiration pour forcer l'humain à rester dans la boucle décisionnelle de ces nouveaux types d'armes.

L'association mène déjà une campagne "Stop Killer Robots" pour tenter de créer une législation internationale interdisant l'usage d'armes totalement autonomes, à l'instar des interdictions sur les armes chimiques ou biologiques.

Le rapport met en avant que la présence humaine dans la chaîne décisionnelle peut introduire le principe de la compassion, ce dont sont dépourvues les machines, tandis que céder le droit de vie ou de mort à des machines priverait "les personnes de leur dignité intrinsèque".

Cela permettrait également d'imputer des responsabilités pour les actes commis mais aussi de mettre en avant les principes de distinction et de proportionnalité. Les discussions en cours ne devraient pas aboutir à des décisions formelles, précise l'association, mais elles vont contribuer à établir un consensus et une base de travail pour une future législation.