Dans son arsenal de lutte contre le suicide, le réseau social Facebook indique tester le recours à l'intelligence artificielle. Des débuts avec un déploiement qui concerne pour le moment seulement les États-Unis dans le cadre d'un test dit limité.

Cette approche est basée sur la reconnaissance de formes qui est une branche de l'intelligence artificielle faisant essentiellement appel et très similaire à l'apprentissage automatique. Elle se concentre sur la reconnaissance de modèles et de régularités dans des données.

Il s'agira d'identifier des publications " très susceptibles " d'inclure des " pensées suicidaires ", ainsi que d'exploiter l'intelligence artificielle, qui a été entraînée à reconnaître de tels messages sur la base de signalements par les utilisateurs, pour faciliter les signalements.

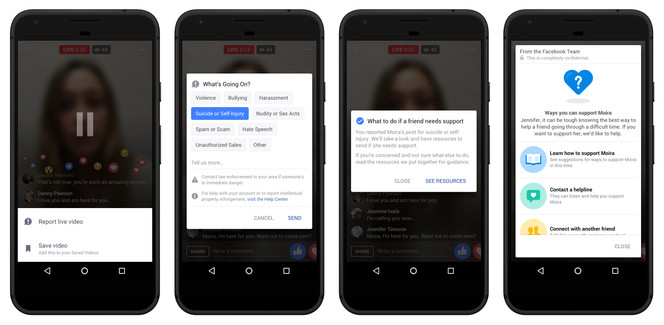

Le cas échéant, une équipe de Facebook prendra des dispositions comme c'était déjà le cas en fonction de signalements humains, tandis que des options pour des signalements sur des publications seront automatiquement mises en avant à l'instar d'un risque de suicide ou d'automutilation.

Au-delà de l'intelligence artificielle, Facebook ajoute que ses outils de prévention contre le suicide seront intégrés dans Facebook Live, et donc pour signaler des vidéos en direct qui évoquent un risque de suicide et fournir de l'aide. Facebook travaille en lien avec des associations spécialisées.

L'intelligence artificielle à la manœuvre

Le mois dernier, Mark Zuckerberg a publié un manifeste sur le rôle que jouera Facebook afin de " créer une communauté mondiale " et " rassembler l'humanité. " Du Mark Zuckerberg pur jus… Le patron de Facebook a fait mention du rôle de l'intelligence artificielle.

" Nous travaillons sur des systèmes qui peuvent analyser des photos et vidéos pour identifier les contenus que nos équipes doivent regarder (ndlr : pour la modération). […] Il faudra plusieurs années pour développer ces systèmes de manière complète. "

Il a ajouté : " Actuellement, nous commençons à explorer des façons d'utiliser l'intelligence artificielle pour faire la différence entre des actualités sur le terrorisme et la propagande terroriste. Ainsi, nous pouvons supprimer rapidement quiconque essaie d'utiliser nos services pour recruter pour une organisation terroriste. C'est techniquement difficile. "

La modération - au sens large - avec l'aide de l'intelligence artificielle ne concerne pas uniquement Facebook mais bien d'autres acteurs comme Twitter par exemple.