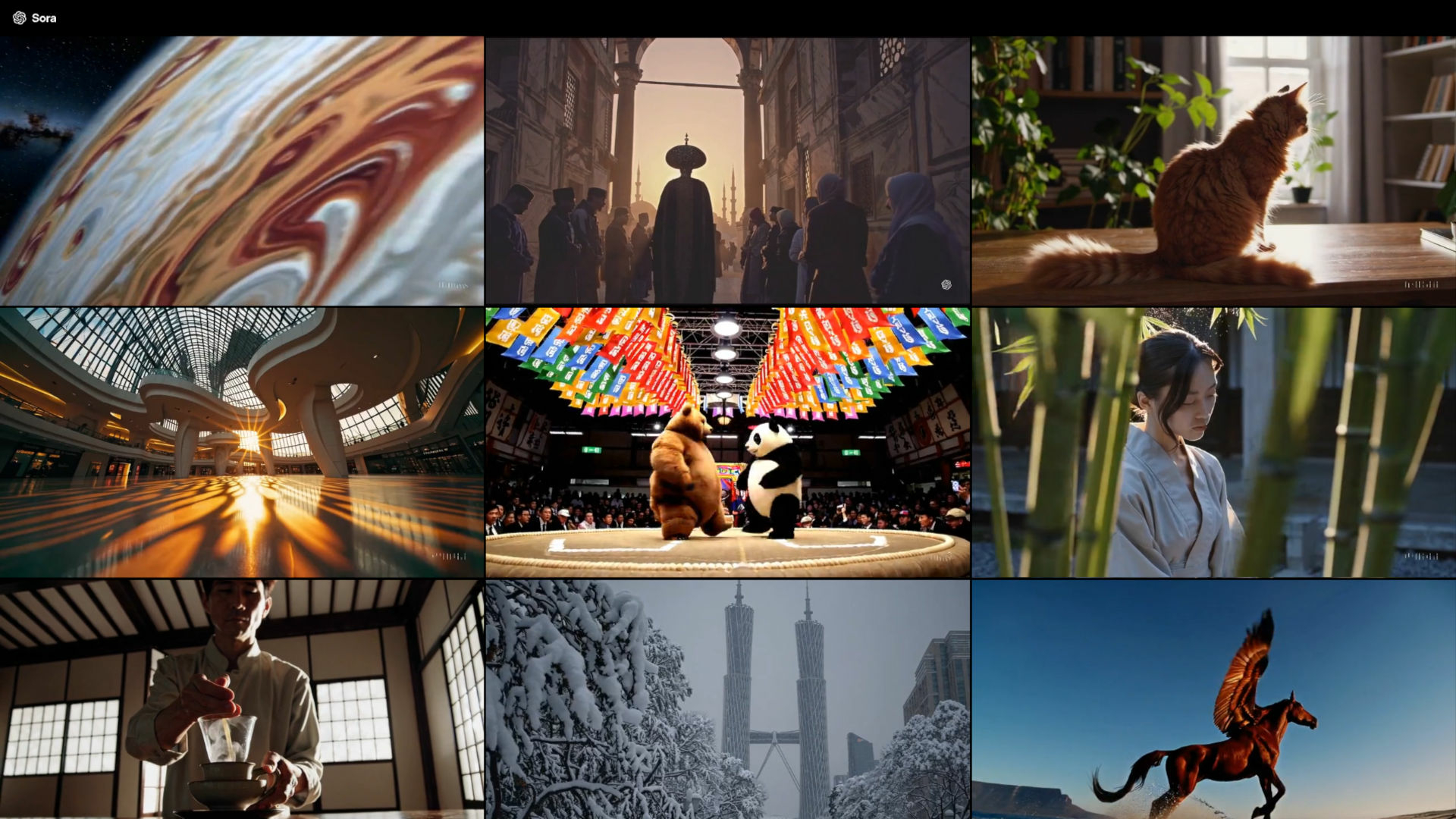

La situation devenait intenable. Depuis le lancement de Sora 2, le puissant générateur de vidéos d'OpenAI, les vidéos hypertruquées se sont multipliées, utilisant l'apparence de personnalités publiques sans aucun accord. Le cas de l'acteur Bryan Cranston, qui a vu son image et sa voix répliquées dans diverses créations, a agi comme un catalyseur, forçant l'entreprise à réagir publiquement.

Comment OpenAI a-t-il réagi à la controverse ?

Face à la polémique grandissante et à la pression des poids lourds de Hollywood, dont le syndicat d'acteurs SAG-AFTRA, la société n'a eu d'autre choix que de marquer un temps d'arrêt. Dans une déclaration commune avec Bryan Cranston et plusieurs agences artistiques, l'entreprise a « exprimé ses regrets pour ces générations involontaires ».

Plus concrètement, OpenAI s'est engagé à renforcer ses garde-fous autour de sa politique de réplication de l'apparence et de la voix. Initialement fondée sur un système de retrait (opt-out) qui avait suscité l'indignation, la politique s'oriente désormais vers un consentement préalable obligatoire (opt-in), redonnant aux artistes le plein contrôle sur la simulation de leur identité.

Quelles sont les garanties pour les artistes ?

L'acteur de Breaking Bad s'était montré profondément préoccupé, pas uniquement pour lui-même mais pour « tous les artistes dont le travail et l'identité peuvent être détournés ». Les nouvelles mesures visent à les rassurer.

OpenAI assure désormais que tous les artistes, via un consentement explicite, auront le droit de déterminer comment et s'ils peuvent être simulés. La société s'est également engagée à examiner « avec diligence » toute plainte pour violation de cette politique. Cette inflexion représente une victoire pour les professionnels de la création, qui se sentaient vulnérables face à cette nouvelle vague technologique.

Ce renforcement est-il suffisant face à la loi ?

Cet accord, bien que salué, ne constitue pas une solution définitive. Toutes les parties prenantes, d'OpenAI à Cranston en passant par la SAG-AFTRA, ont profité de cette tribune pour afficher leur soutien total à un projet de loi fédéral : le NO FAKES Act.

Ce projet législatif vise à offrir un cadre légal solide pour protéger les individus contre l'utilisation non autorisée de leur image et de leur voix par des outils d'intelligence artificielle. Les récents incidents impliquant des deepfakes irrespectueux de Martin Luther King Jr. ont d'ailleurs souligné l'urgence d'une législation claire et stricte en la matière.