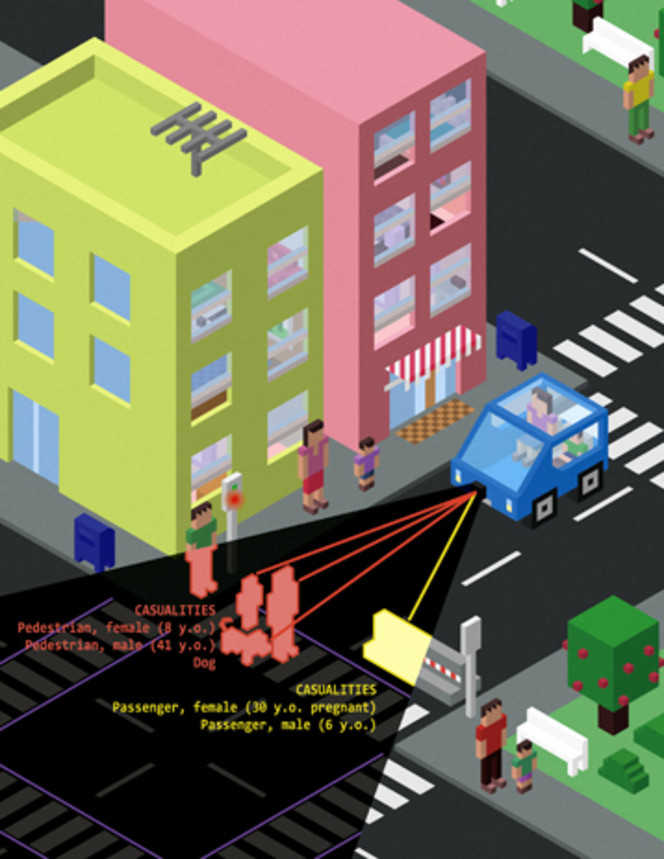

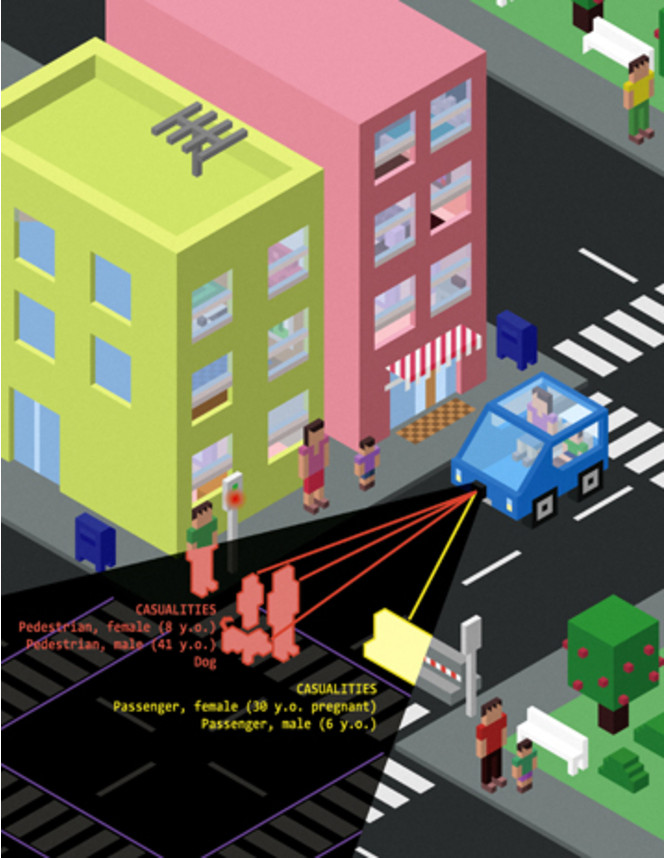

Une voiture autonome pilotée par une intelligence artificielle embarquant des passagers voit surgir de nulle part des piétons qu'elle ne peut éviter. Soit elle dévie de sa route et tue les passagers, soit elle poursuit son chemin et tue les piétons mais sauve ses passagers. Quel choix doit-elle faire ?

Des chercheurs du CNRS, de l'Université d'Orégon et du MIT ont proposé différents scénarios de ce type à un panel d'environ 2000 citoyens américains en leur demandant ce que devrait faire l'intelligence artificielle face à ce dilemme moral.

Les personnes interrogées ont eu tendance en général à sacrifier les passagers pour "le bien du plus grand nombre", même dans les cas où des enfants seraient présents dans le véhicule autonome. Pour autant, cette position altruiste est renversée quand ces mêmes personnes prennent conscience qu'elles pourraient être les passagers du véhicule autonome.

Elles plébiscitent alors des véhicules sans chauffeur qui les protégeraient avant tout, au détriment des piétons, quand elles considèrent le point de vue qu'en faisant l'acquisition d'une voiture autonome, celle-ci décidera de les tuer pour sauver un groupe de piétons en cas d'accident inévitable, conformément à leur réponse initiale aux dilemmes posés.

En résumé, les personnes interrogées souhaitent que le véhicule autonome sauve les piétons quand ce n'est pas leur véhicule...mais que ce même véhicule les protège avant tout quand ils en sont les utilisateurs.

Allant jusqu'au bout de la logique, les chercheurs ont étudié les intentions d'achat de véhicules sans chauffeur dans le cas où une législation imposerait que l'intelligence artificielle sauve les piétons plutôt que les passagers.

Dans ce cas, les personnes interrogées se montrent très peu disposées à acquérir un véhicule autonome, même en sachant que ces derniers seront beaucoup plus sûrs que des véhicules traditionnels et que les scénarios d'accident décrits seront beaucoup plus rares.

Au final, ce rejet pourrait "avoir l'effet paradoxal de coûter davantage de vies, en freinant l'adoption par les citoyens d'une technologie plus sûre", notent les chercheurs. Google a bien une réponse intermédiaire en se proposant de scotcher les piétons sur le capot de ses véhicules autonomes...

Vous pouvez toujours tenter de vous confronter aux situations morales représentées par divers scénarios au travers du site Moral Machine du MIT.