C'est la coutume pour Apple. Le mois précédent sa conférence WWDC, le groupe réserve des annonces en matière de nouvelles fonctionnalités d'accessibilité qui arriveront d'ici la fin de l'année en cours pour ses systèmes d'exploitation.

En l'occurrence, difficile dès lors de ne pas penser à iOS 19, iPadOS 19, watchOS 12, macOS 16 ou encore visionOS 3 qui ne sont toutefois jamais explicitement cités par Apple.

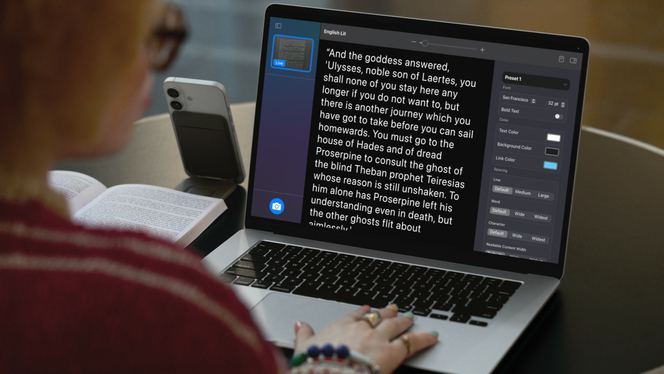

Accessibility Reader dans l'application Loupe

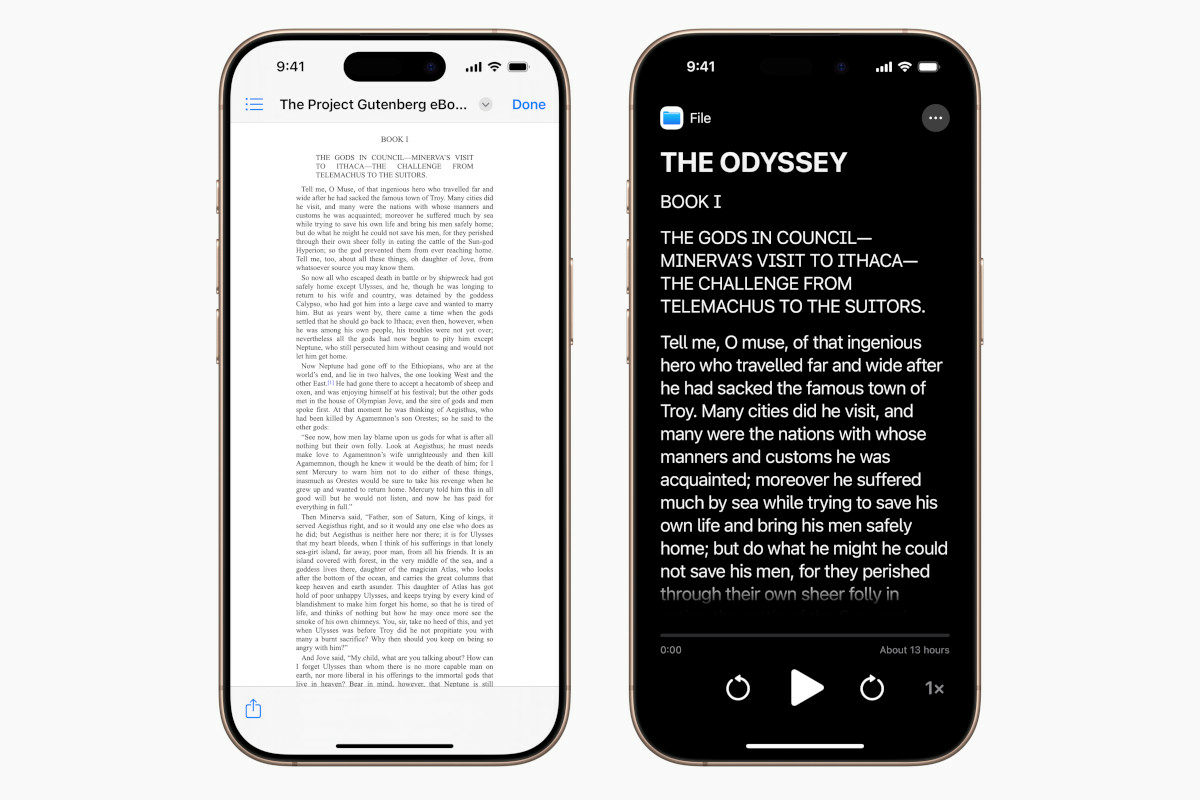

Sur iPhone, iPad, Mac et Apple Vision Pro, un nouveau mode de lecture Accessibility Reader à l'échelle du système pourra être ouvert depuis n'importe quelle application et sera intégré à l'application Loupe (qui arrive sur Mac et avec Continuity Camera sur iPhone).

Accessibility Reader proposera des options de personnalisation pour la police, la couleur, l'espacement et prendra en charge la lecture audio. Il s'adresse aux personnes ayant des troubles de la lecture, comme la dyslexie ou des problèmes de vue.

Braille Access transformera l'iPhone, l'iPad, le Mac et l'Apple Vision Pro en un preneur de notes braille complet et Apple souligne une intégration profonde à son écosystème.

Live Captions en français

Pour les sous-titres en temps réel, Live Captions va prendre en charge davantage de langues, dont le français, et arrive sur Apple Watch. Il sera possible de voir les sous-titres de ce que l'iPhone capture, tout en écoutant l'audio sur des AirPods ou des aides auditives.

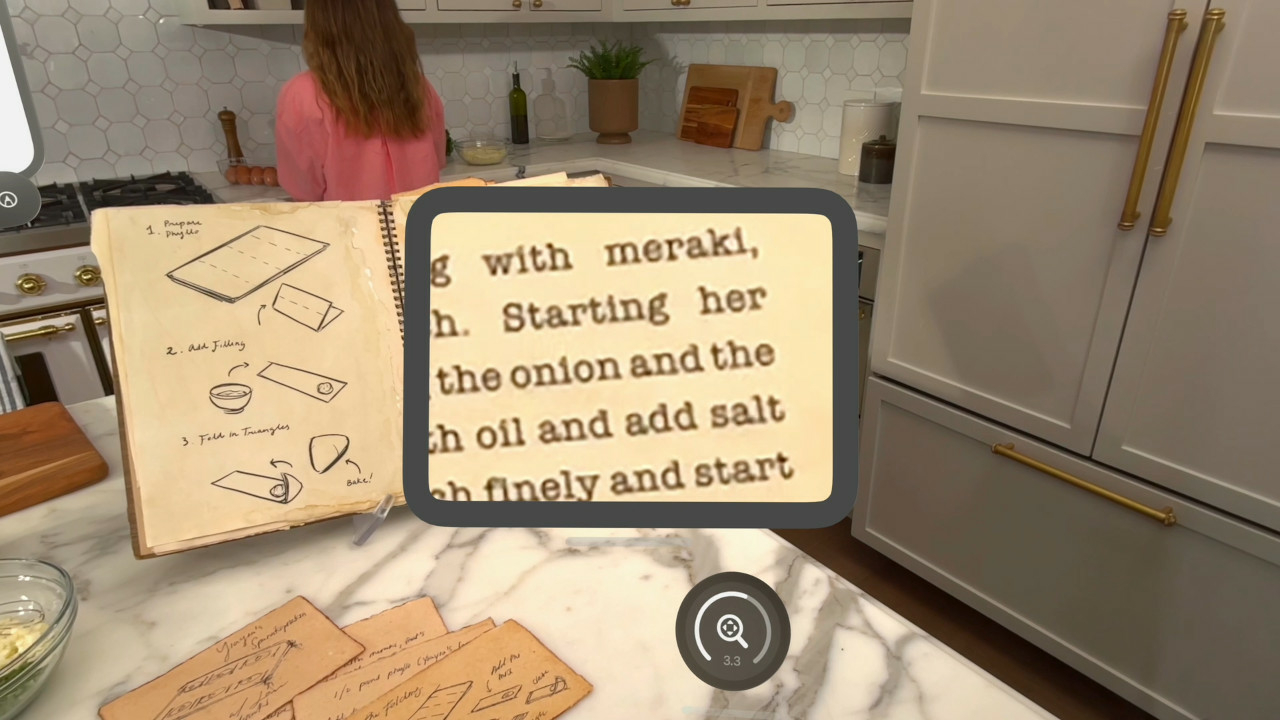

Avec l'Apple Vision Pro, tout ce qui se trouve dans le champ de vision pourra être agrandi grâce à la caméra principale. Pour les utilisateurs de VoiceOver, Live Recognition dans visionOS utilisera le machine learning sur l'appareil afin de décrire l'environnement, trouver des objets et lire des documents.

Dans l'App Store, une section dédiée sera par ailleurs ajoutée aux pages produits pour mettre en évidence les fonctionnalités d'accessibilité présentes dans les applications et les jeux.

N.B. : Source images : Apple.