En marge du déploiement à grande échelle de Copilot Voice et Copilot Vision sur Windows 11, Microsoft a annoncé les Copilot Actions. Des agents IA vont être en mesure d'exécuter des tâches complexes directement sur les fichiers et applications.

La fonctionnalité sera prochainement disponible pour les membres du programme Windows Insiders via les Copilot Labs. Elle étend les possibilités déjà vues sur le Web en permettant à l'IA d'interagir avec l'environnement local de l'utilisateur. Il y a forcément des risques de sécurité inhérents à cette autonomie de l'IA.

Des Copilot Actions et de nouveaux risques

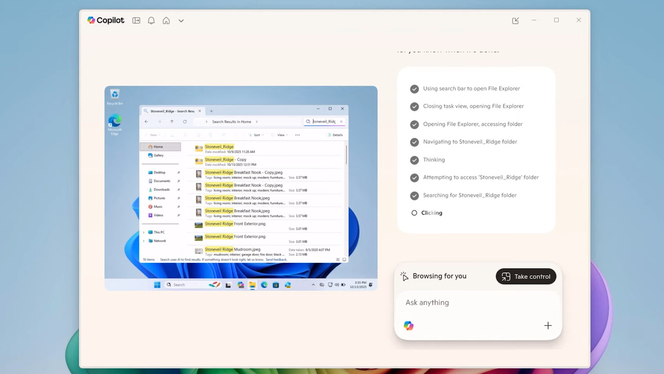

Copilot Actions est un agent d'IA conçu pour exécuter des tâches en interagissant avec vos applications et vos données locales. Il utilise des capacités de vision et de raisonnement avancé pour simuler des actions humaines.

Cette évolution vers des agents IA introduit de nouveaux risques. Au-delà des hallucinations des modèles de langage, Microsoft évoque des menaces spécifiques comme le cross-prompt injection (XPIA), où un contenu malveillant intégré dans un document pourrait détourner les instructions de l'agent pour exfiltrer des données ou installer un malware.

C'est pour répondre à de tels dangers que le groupe de Redmond met en place une nouvelle doctrine de sécurité.

Comment Microsoft compte-t-il sécuriser les agents IA ?

Face à ces enjeux, Microsoft a établi un ensemble de principes de sécurité et de confidentialité stricts, intégrés dans son initiative Secure Future.

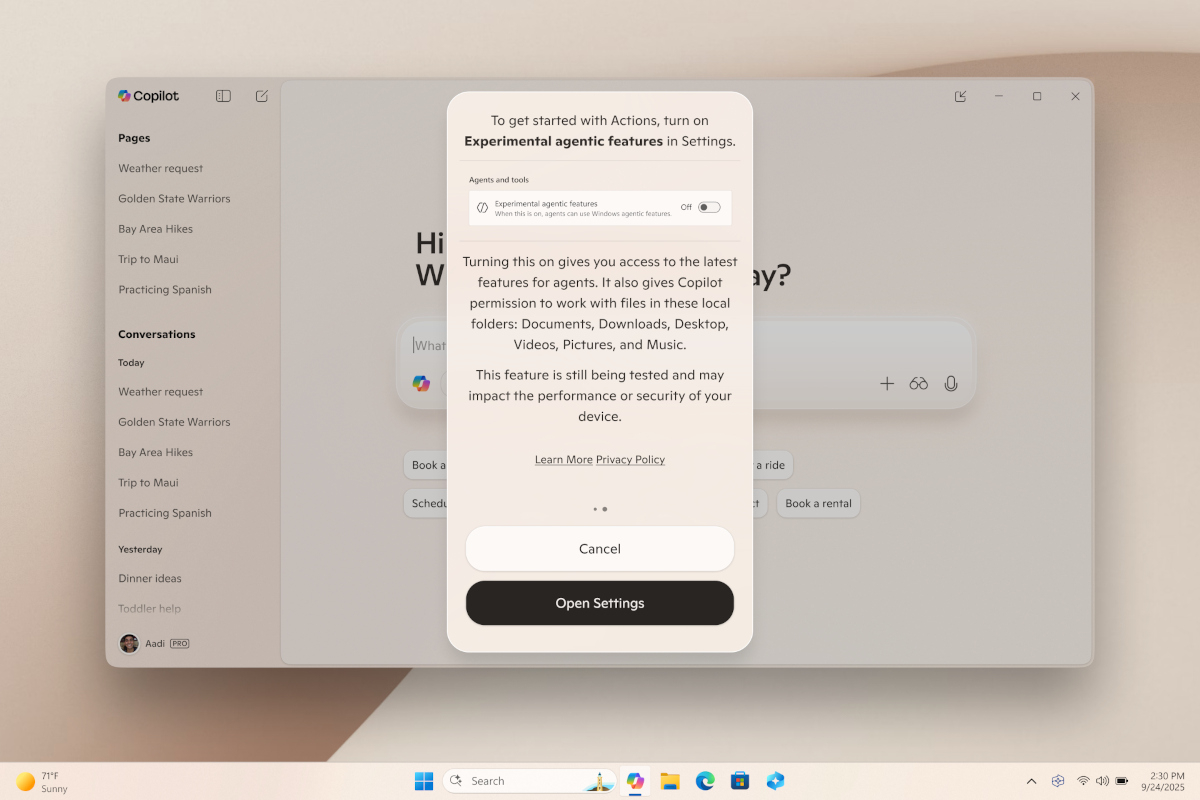

Chaque agent IA opérera via un compte dédié, distinct de celui de l'utilisateur, ce qui permet d'appliquer des politiques de sécurité spécifiques et granulaires. Ces agents démarreront avec des privilèges extrêmement limités, n'ayant accès qu'à des dossiers utilisateur connus (Documents, Téléchargements, Bureau, Images). L'accès à d'autres ressources nécessitera une autorisation explicite de l'utilisateur et pourra être révoqué à tout moment.

Pour garantir la confiance, tous les agents IA devront être signés numériquement par une source fiable, permettant à Microsoft de révoquer les certificats d'agents malveillants ou défaillants. Enfin, l'ensemble du système est conçu pour respecter la déclaration de confidentialité et la norme d'IA responsable de Microsoft.

Un environnement confiné Agent Workspace

Pour mettre en pratique ces principes, Windows 11 intègre plusieurs nouveaux composants. Le pilier de cette architecture est l'Agent Workspace, un environnement de travail contenu et isolé où l'agent exécute ses tâches.

Il s'agit techniquement d'une session enfant du Bureau à distance Windows, ce qui garantit une séparation stricte avec le bureau principal de l'utilisateur. Chaque application gérera son propre espace de travail, empêchant les interférences entre agents.

Par ailleurs, la fonctionnalité sera désactivée par défaut. L'utilisateur devra l'activer manuellement via les paramètres. Une fois en action, l'utilisateur pourra surveiller en temps réel le travail de l'agent, rester informé de chaque étape et reprendre le contrôle à tout instant.

Bientôt à l'épreuve du feu...

Pour les actions jugées sensibles, Copilot Actions demandera une approbation supplémentaire, assurant que l'utilisateur reste maître de son appareil. Microsoft précise que d'autres briques de sécurité, comme le support des identités Entra et MSA, seront ajoutées prochainement.

Le début des Copilot Actions sur Windows 11 sera inévitablement surveillé de très près par la communauté de la cybersécurité, d'où l'intérêt d'un passage préalable par les Copilot Labs pour essuyer les plâtres.

Difficile de ne pas se souvenir de l'arrivée chaotique (en preview) de la fonctionnalité IA Recall sur Copilot+ PC. Microsoft avait dû revoir sa copie en matière de sécurité après une alerte d'experts tiers.