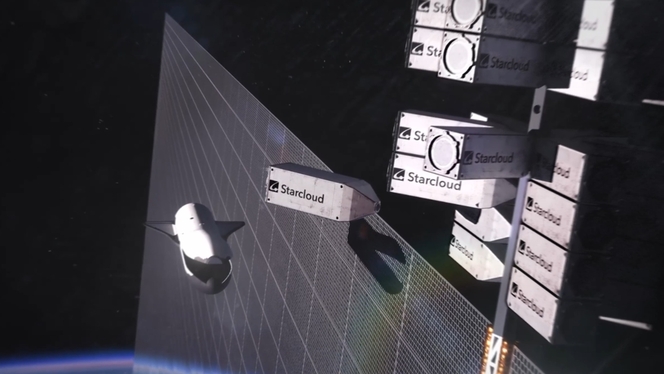

L'intelligence artificielle et les datacenters dans l'espace, c'est pour bientôt. La startup Starcloud, en partenariat avec Nvidia, s'apprête à lancer le premier GPU H100 en orbite dès novembre 2025.

Cette mission vise à tester la viabilité des data centers spatiaux, alimentés par l'énergie solaire et refroidis par le vide, pour répondre à la demande énergétique croissante de l'IA. Crusoe sera le premier client cloud.

Le défi énergétique des "usines à IA"

Le déploiement massif de l'intelligence artificielle générative met les infrastructures terrestres à rude épreuve. Les datacenters actuels consomment déjà des gigawatts d'électricité, l'équivalent de villes entières, et leur construction pose des problèmes d'utilisation des sols.

Cette demande énergétique exponentielle soulève de sérieuses inquiétudes environnementales, notamment sur la consommation d'eau pour le refroidissement. C'est dans ce contexte tendu que plusieurs entreprises lèvent les yeux vers l'espace.

Starcloud-1 : un H100 en orbite

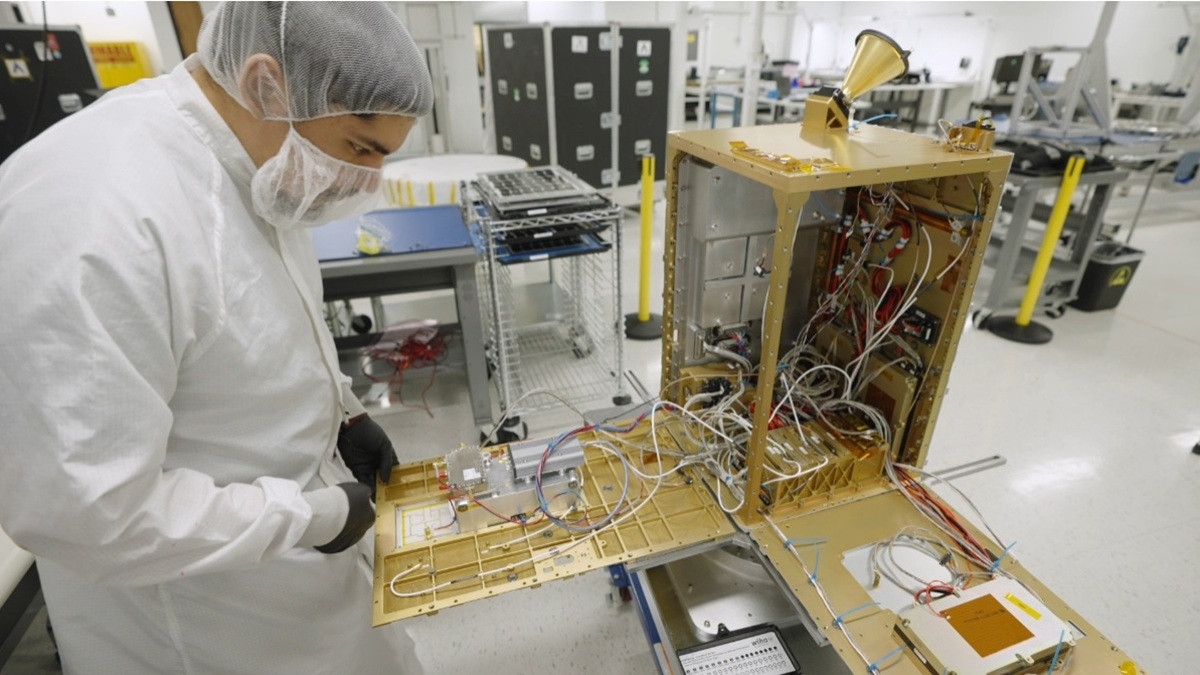

La startup Starcloud, basée à Redmond et soutenue par Nvidia, s'apprête à franchir une étape décisive. Dès le mois prochain, en novembre 2025, elle lancera son satellite Starcloud-1.

Ce satellite de démonstration, pesant environ 60 kg et de la taille d'un petit réfrigérateur, embarquera la première puce Nvidia H100 destinée à l'orbite terrestre. Selon Nvidia, cet accélérateur offrira une puissance de calcul 100 fois supérieure à tout ce qui a été déployé dans l'espace jusqu'à présent.

Le lancement est prévu sur une fusée Falcon 9 de SpaceX. L'entreprise Crusoe, spécialisée dans les infrastructures délocalisées, a déjà annoncé qu'elle serait le premier opérateur cloud à utiliser cette technologie via un satellite prévu pour fin 2026, avec une disponibilité limitée début 2027.

Énergie solaire infinie et "climatisation cosmique"

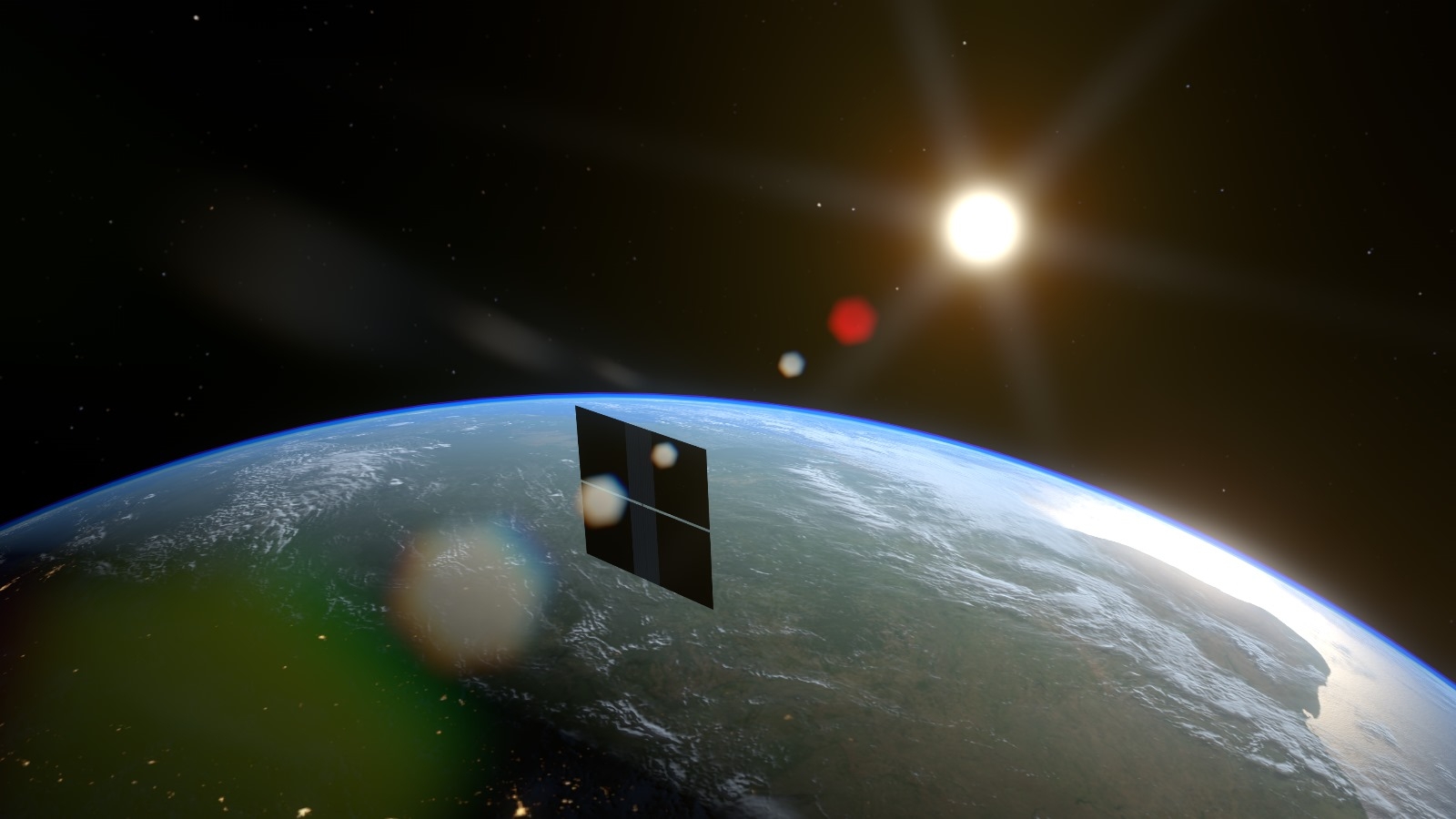

L'intérêt de délocaliser les data centers en orbite est double. D'abord, l'énergie. Les satellites peuvent être équipés d'immenses panneaux solaires, leur assurant une exposition constante au soleil et un accès à une énergie quasi illimitée, sans dépendre des réseaux terrestres ni de batteries de secours.

Ensuite, le refroidissement. Sur Terre, le refroidissement des GPU est un gouffre énergétique et hydrique. Dans l'espace, le problème est inversé. Starcloud utilisera le vide spatial comme un "puits de chaleur infini".

La chaleur des composants sera conduite vers des radiateurs externes qui l'émettront sous forme de rayonnement infrarouge dans le vide glacial de l'espace. Nvidia parle de "climatisation cosmique", un système efficace qui n'utilise ni air, ni eau.

Vers des data centers à l'échelle du gigawatt ?

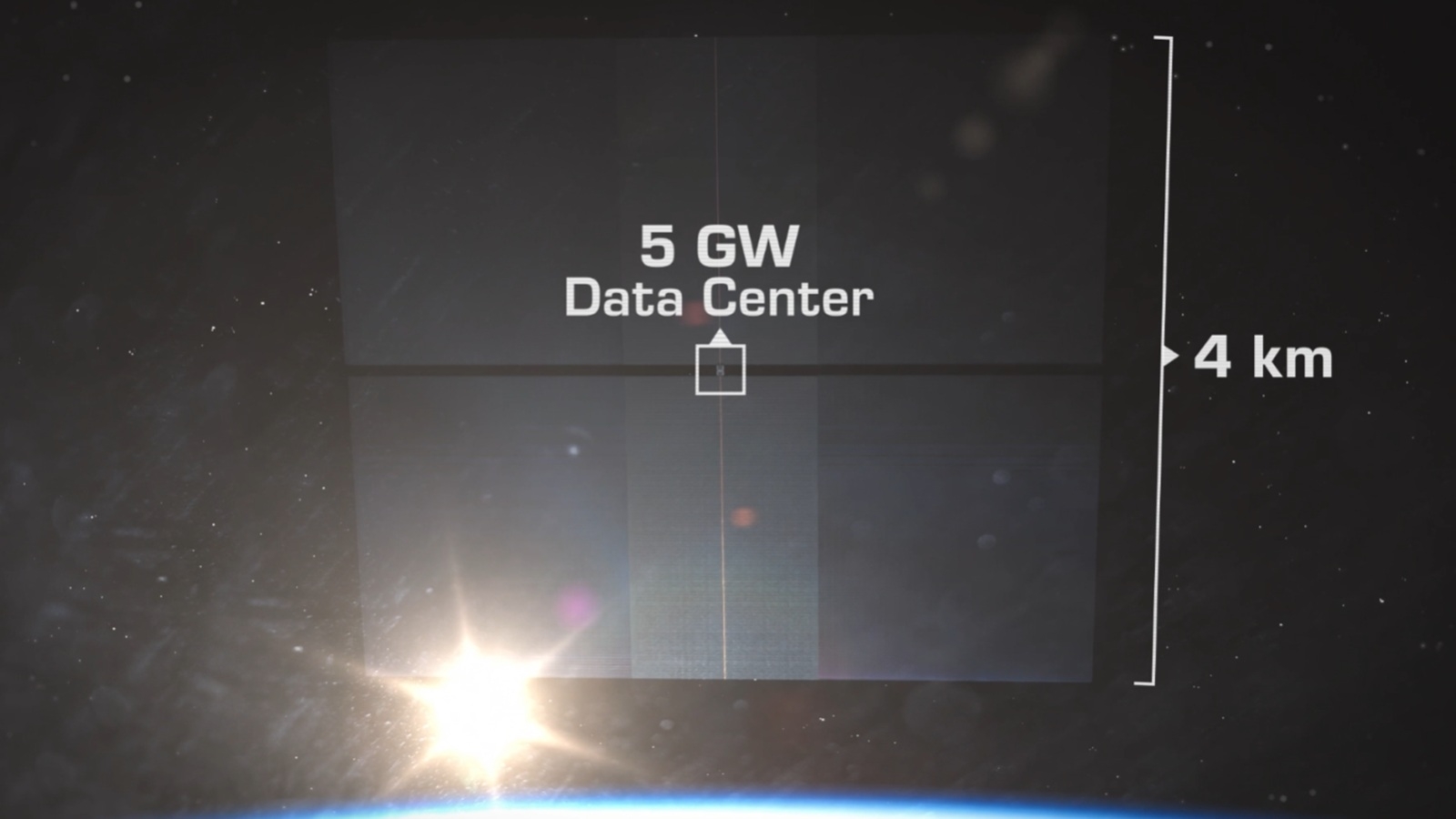

Le satellite Starcloud-1 n'est qu'un premier pas. L'ambition de Starcloud est de construire, à terme, un data center orbital à l'échelle du gigawatt.

Ce projet futuriste impliquerait des panneaux solaires mesurant 4 km de côté. Si le test de novembre est concluant, il pourrait ouvrir la voie à une nouvelle ère pour le cloud computing, délestant la Terre d'un fardeau énergétique croissant tout en traitant les données d'observation directement depuis l'orbite.