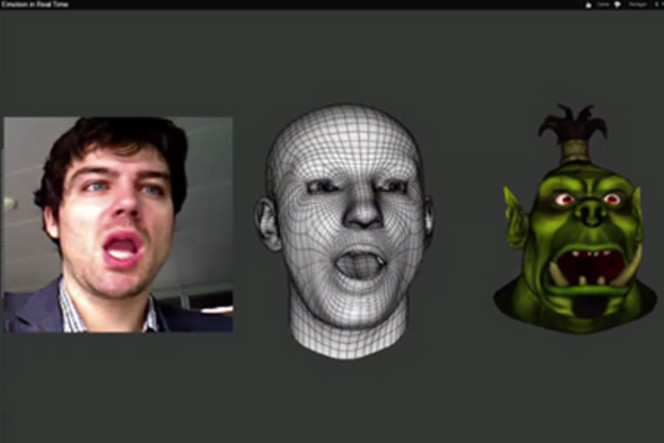

Plus qu'un outil permettant de se dupliquer dans un environnement virtuel, le logiciel développé par les chercheurs de l'EPFL permet de reproduire des expressions et des mouvements sur un avatar en temps réel.

Equipé d'une caméra 3D comme celle que propose le système Kinect de Microsoft, il sera alors possible de partager des expressions pendant des discussions en ligne dans des univers virtuels. Plus besoin de chercher la combinaison de touches ou le smiley à pianoter, il suffit de tirer la moue, sourire, cligner des yeux ou tirer la langue devant son écran pour que l'Avatar reproduise simultanément les grimaces.

En outre le système permettra également de reproduire fidèlement le visage des utilisateurs, ou d'analyser leur morphologie pour y appliquer des skins différents de façon automatique et bénéficier ainsi d'expressions plus fidèles.

Le système étonne également par le fait qu'il se montre capable de suivre le regard de l'utilisateur, bien que la fonction soit anecdotique puisque les joueurs ne devraient pas quitter leur écran du regard... Une fonction qui se montre pourtant intéressante pour d'éventuelles applications en dehors du cadre vidéoludique, comme pour le cinéma, ou la télévision.

Le logiciel devrait dans un premier temps se rendre disponible auprès des développeurs de jeux vidéo, leur permettant d'ajouter un peu plus d'authenticité dans les expressions de leurs héros sans avoir recours à des solutions de motion capture couteuses et chronophages.

Les chercheurs à l'origine du projet annoncent attendre avec impatience la sortie de nouvelles caméras 3D plus performantes que celles actuellement disponibles, permettant une plus grande précision de capture synonyme d'encore plus de réalisme au niveau des émotions retranscrites. Si le fonctionnement du système est aussi aisé que dans la vidéo de présentation, nul doute que les grands du jeu vidéo n'hésiteront pas à adopter le logiciel afin de vendre leur propre dispositif de capture 3D, Microsoft ayant déjà un coup d'avance sur ce point.