Avec l'émergence de la navigation agentique, où une intelligence artificielle peut effectuer de manière autonome des tâches complexes, un nouveau type de menace est apparu : l'injection indirecte de prompts.

Des contenus malveillants dissimulés sur une page web pourraient manipuler l'agent IA pour lui faire exécuter des actions non désirées, comme effectuer des transactions frauduleuses ou exfiltrer des données personnelles.

Pour contrer ce danger, Google a conçu une défense en couches dans Chrome qui combine des règles déterministes et des protections probabilistes.

S'assurer que l'IA ne déraille pas

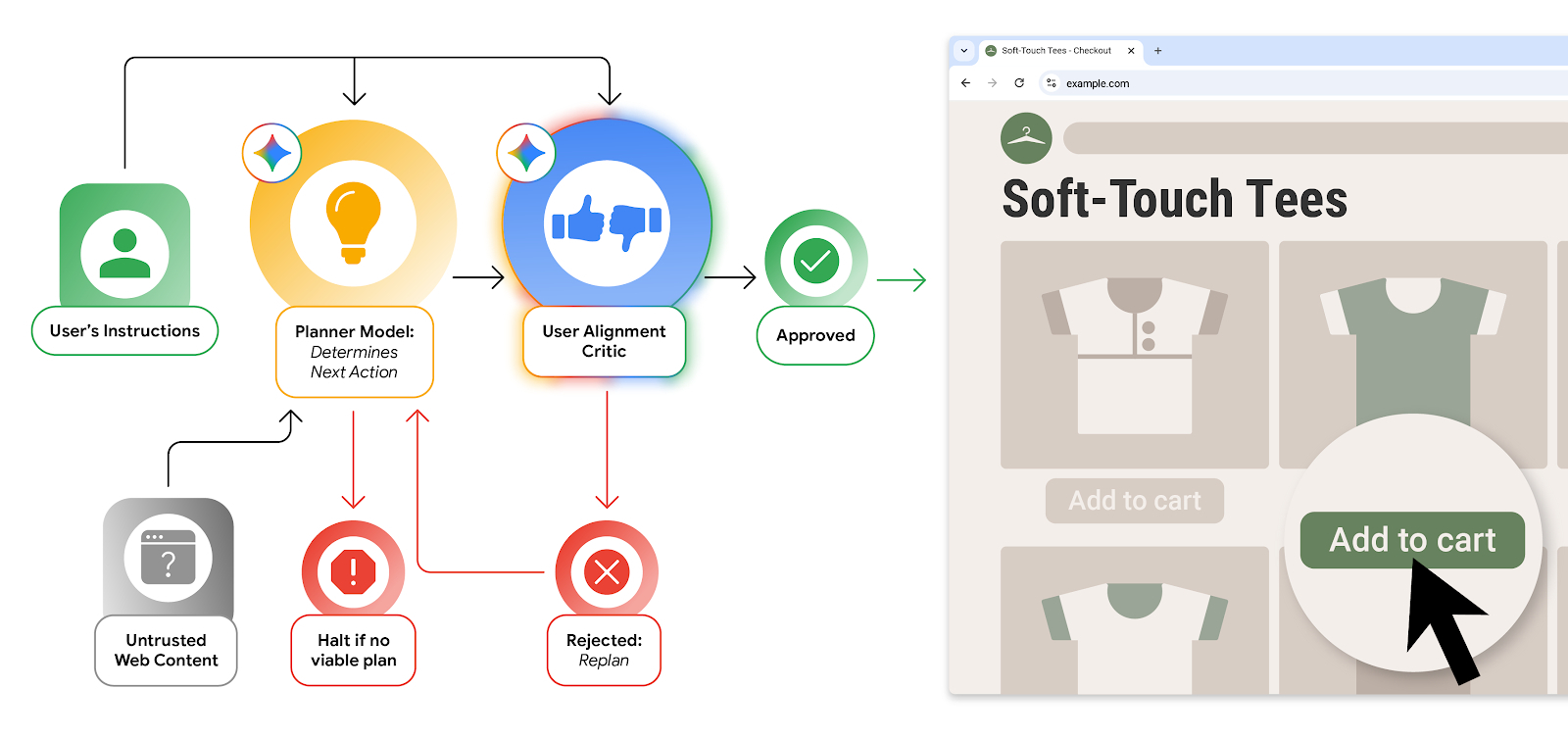

La pièce maîtresse de la nouvelle architecture est le User Alignment Critic. Il s'agit d'un second modèle de langage, basé sur Gemini, qui est complètement isolé des contenus web non fiables.

Son rôle est de fonctionner comme un " composant système de haute confiance " en examinant chaque action proposée par l'agent IA principal. Il se concentre sur un seul objectif : vérifier si l'action envisagée sert bien le but initialement fixé par l'utilisateur.

Le User Alignment Critic ne voit que les métadonnées de l'action proposée, et non le contenu web potentiellement corrompu, ce qui l'empêche d'être empoisonné directement depuis le Web. S'il juge une action non alignée ou risquée, il peut y mettre son veto, forçant le modèle principal à revoir son plan ou à rendre la main à l'utilisateur.

Limiter l'accès de l'agent IA au Web

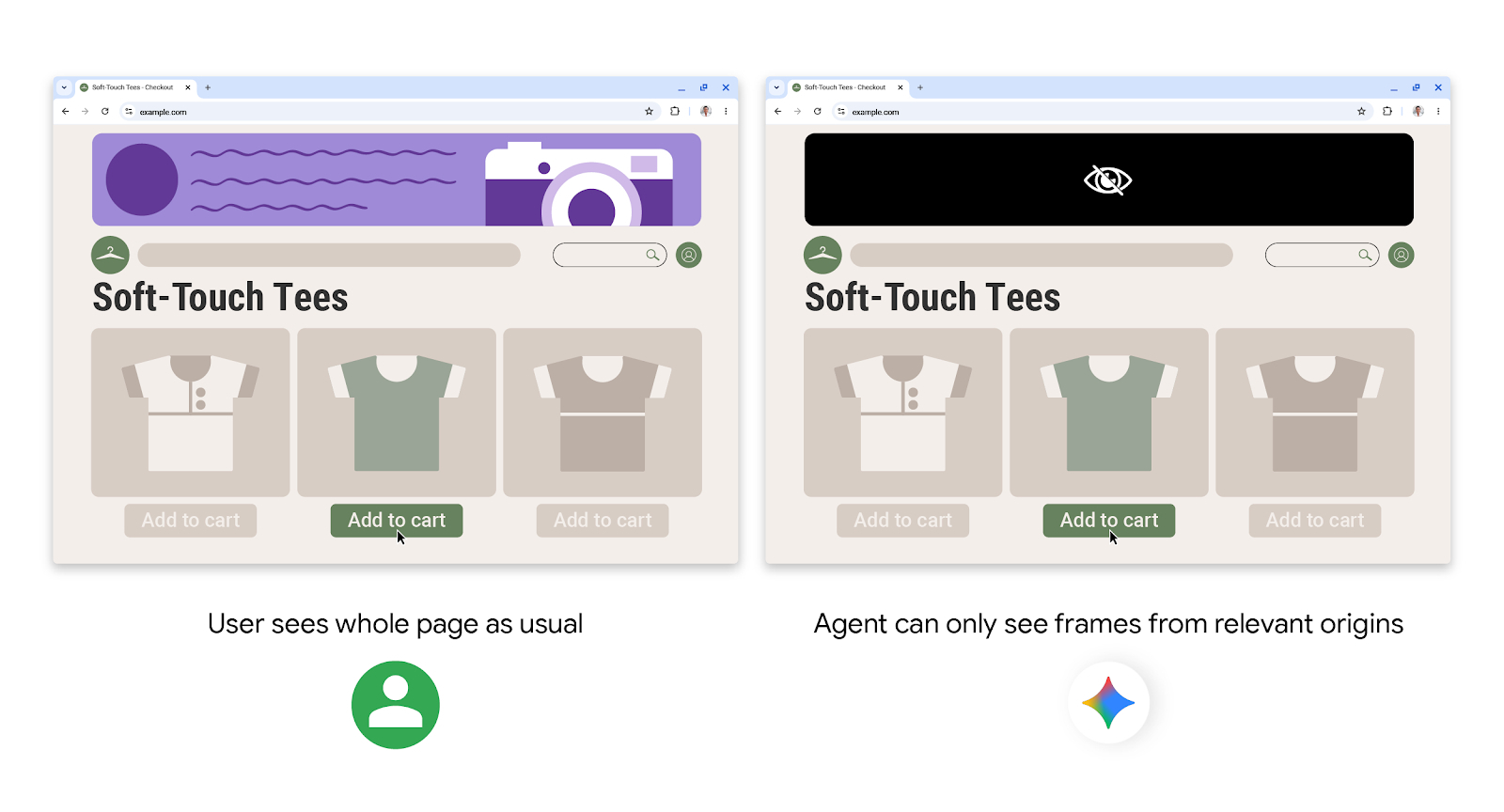

Google étend les principes fondamentaux de sécurité de Chrome, comme Site Isolation, au monde de l'IA avec une fonctionnalité Agent Origin Sets.

Par nature, un agent doit naviguer entre différents sites, mais sans restriction, un agent compromis pourrait contourner les protections existantes. Ce système limite donc l'agent pour qu'il n'accède qu'aux données des origines (sites web) jugées pertinentes pour la tâche en cours.

Une fonction de contrôle sépare les sites en deux catégories : les origines en lecture seule, d'où Gemini peut consommer de l'information, et les origines en lecture-écriture, sur lesquelles il peut agir.

Cette délimitation " limite le vecteur de menace des fuites de données inter-origines ". Ainsi, l'agent ne peut pas lire des informations sur un site non pertinent et les transmettre à un autre, réduisant la surface d'attaque.

Des garde-fous supplémentaires pour l'utilisateur

Au-delà de ces systèmes automatisés, Google insiste sur la transparence et le contrôle direct de l'utilisateur.

Pour toute action jugée sensible, l'agent IA mettra le processus en pause et demandera une confirmation manuelle. Cela inclut la navigation vers des sites sensibles, le recours au gestionnaire de mots de passe, la finalisation d'un achat.

Enfin, la défense est complétée par un classificateur dédié à la détection d'injection de prompts en temps réel, qui fonctionne en parallèle de la protection Safe Browsing.