Les experts appellent cela les hallucinations des IA conversationnelles : les réponses aux requêtes énoncées de façon si affirmative et convaincante peuvent être erronées.

Ce serait même l'un des principaux freins à la démocratisation des chabots dans les grands moteurs de recherche, à défaut de trouver pour le moment un moyen de valider la pertinence et l'exactitude des informations diffusées.

Au-delà des capacités rédactionnelles et de création de contenus que permettent ces robots conversationnels, leur intégration dans les moteurs de recherche comme source d'information reste un sujet délicat.

Jusqu'à quel point faire confiance aux chatbots ?

L'exemple de Bard, l'IA que compte utiliser Google en association avec son moteur de recherche, énonçant une information erronée durant sa présentation officielle a coûté cher au groupe Alphabet et illustre bien la difficulté pour évaluer le degré de confiance dans la réponse apportée.

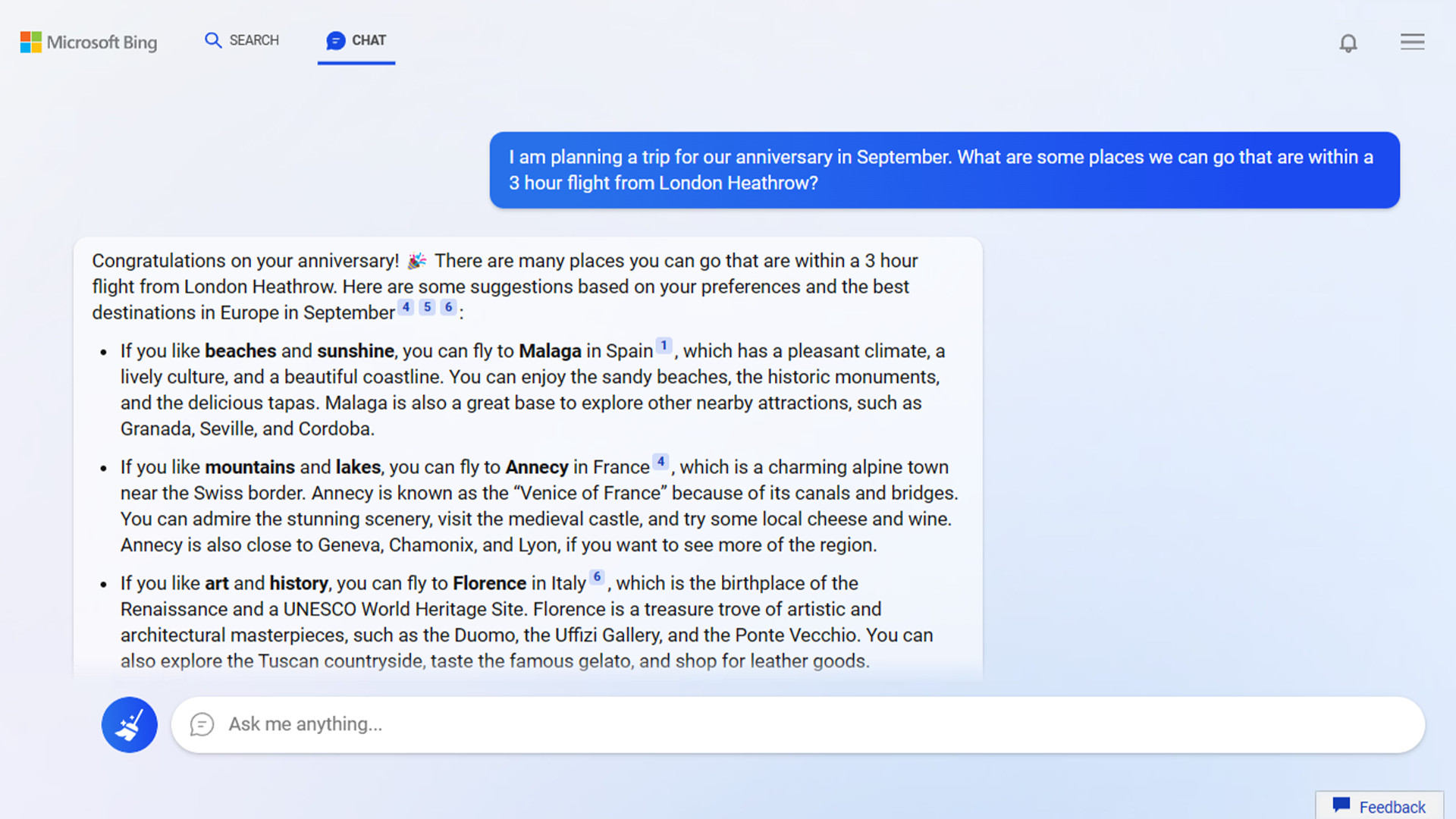

Si l'erreur de Bard a fait le tour du Web, il apparaît que la démonstration de l'IA de Bing chez Microsoft n'était pas non plus exemple de fausses informations. Le chercheur Dmitri Brereton démontre que plusieurs réponses données par Bing lors de la présentation devant des journalistes étaient soit incomplètes soit carrément inventées.

Cela concerne par exemple la présentation de résultats financiers, avec des résultats erronés, ou des affirmations sorties de nulle part. Microsoft a déjà indiqué être au courant de ces erreurs et savoir que Bing IA n'est pas infaillible.

C'est aussi l'une des raisons (comme pour Bard de Google) expliquant pourquoi les IA conversationnelles sont encore en phase de test et de raffinement. Contrairement à ChatGPT accessible à tous, elles restent limitées à un certain nombre de développeurs.

Une révolution qui attend des indices de confiance

De la même manière que personne n'a rien remarqué lors de la démonstration, sa découverte a été fortuite en cherchant à comparer les réponses fournies par les systèmes de Microsoft et Google.

La question de la confiance dans ces nouvelles IA conversationnelles, aussi séduisantes soient-elles, n'est donc pas résolue, même si plusieurs grands noms (dont le PDG de Microsoft Satya Nadella) évoquent ces innovations en termes très élogieux et capables de provoquer une nouvelle révolution dans l'organisation du travail.

Ces hallucinations des chatbots sont pourtant au coeur des réticences de Google pour déployer ce type de technologie dans son moteur de recherche. Sa capacité à modifier l'expérience même de la recherche internet, et par extension de son modèle économique, en fournissant une réponse directe en langage naturel, impose aussi d'avancer avec prudence.

Si les robots conversationnels sont l'avenir, il faut donc prendre garde qu'ils n'ouvrent la porte à un monde de fake news où il ne sera plus possible de distinguer le vrai du faux.