Comme attendu, Nvidia a profité de l'événement GTC 2022 pour présenter une nouvelle architecture graphique Hopper qui constitue une forme d'évolution de Ampere mais spécifiquement destinée aux marchés professionnels et industriels.

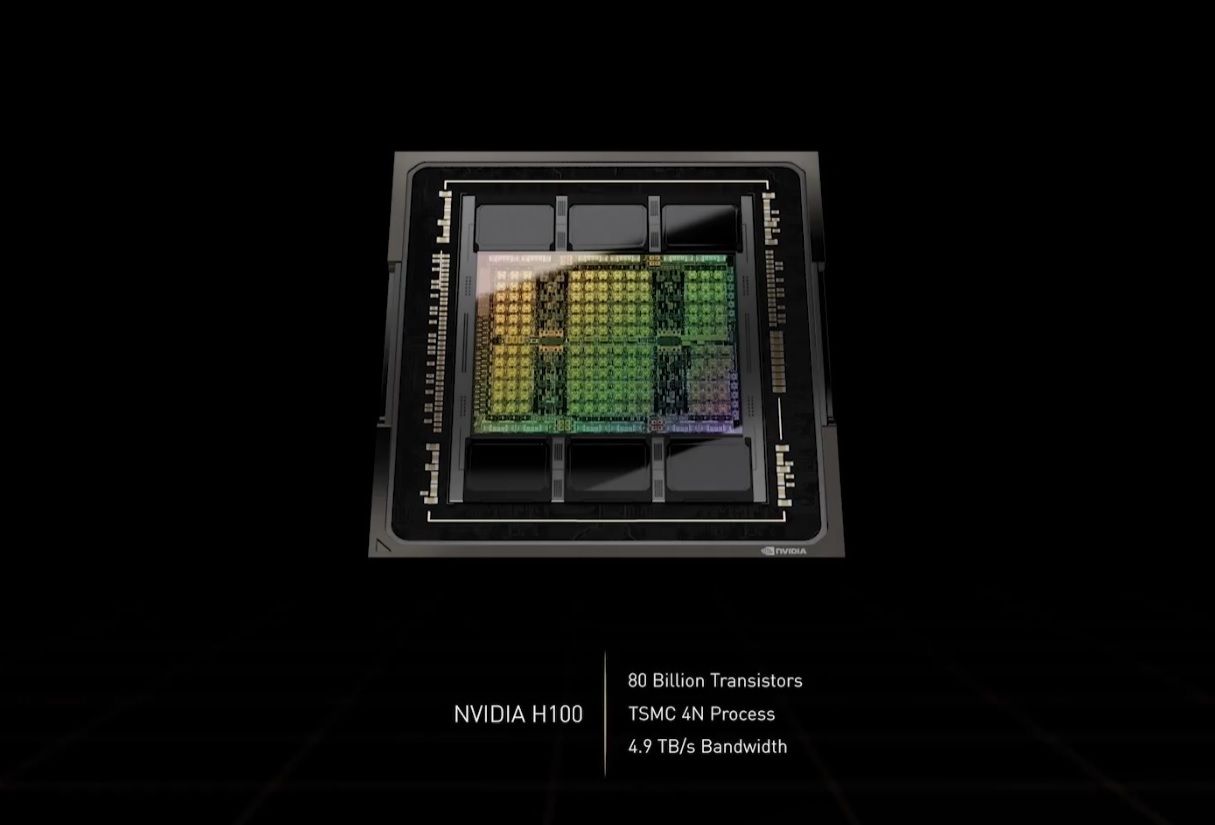

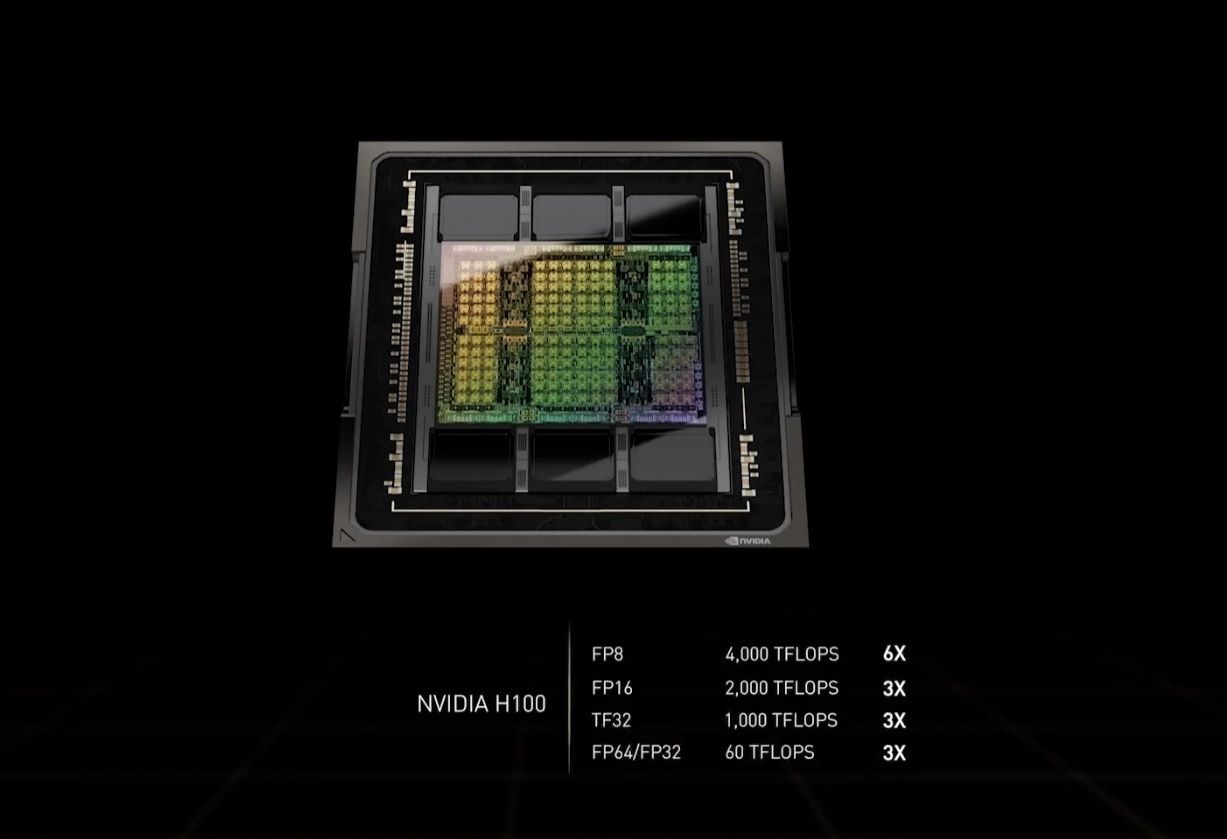

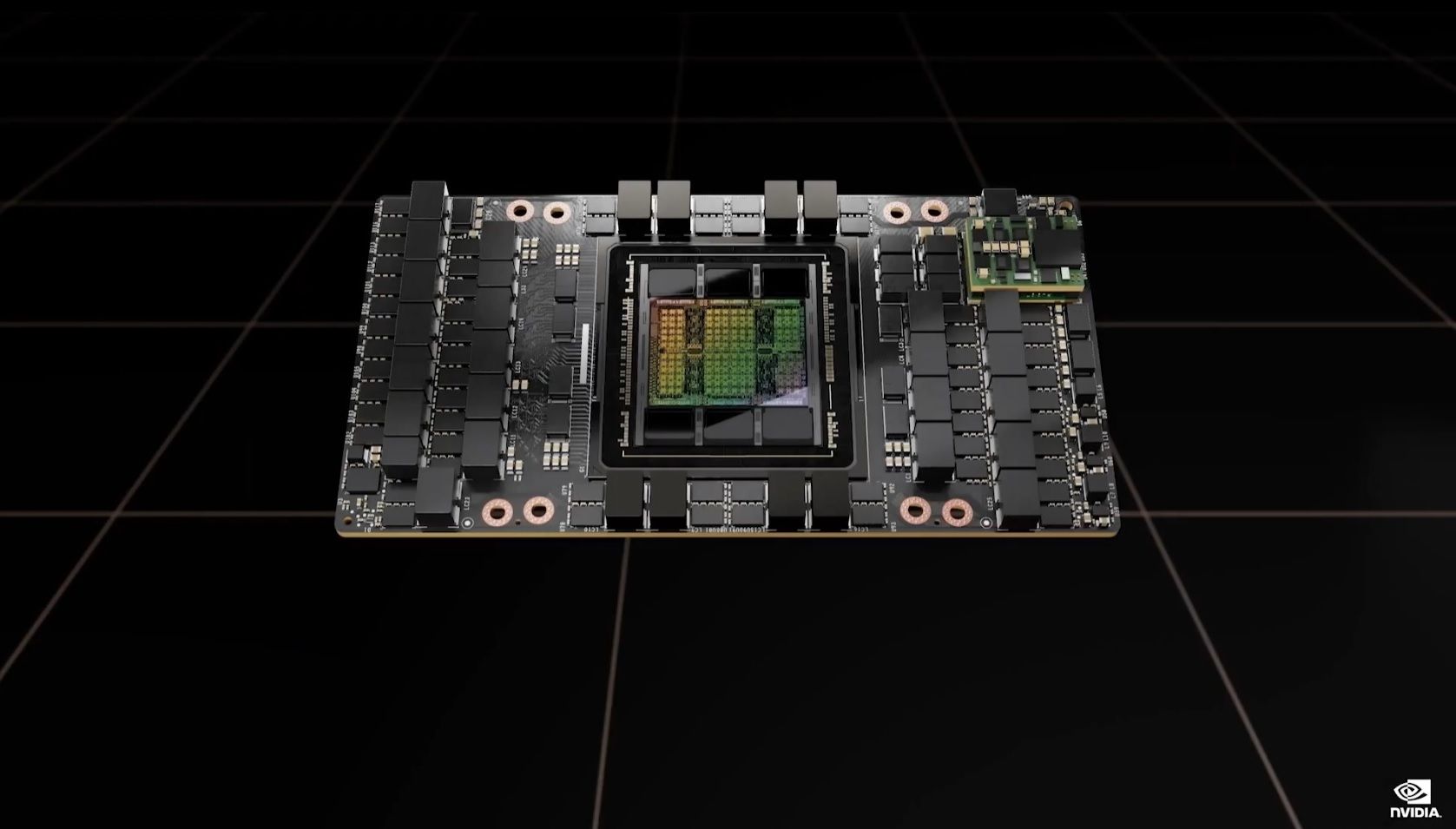

Profitant d'une gravure en 4 nm chez TSMC, elle pousse plus avant les possibilités en matière de traitement d'intelligence artificielle et se retrouve au coeur du nouveau GPU Nvidia H100 aux 80 milliards de transistors.

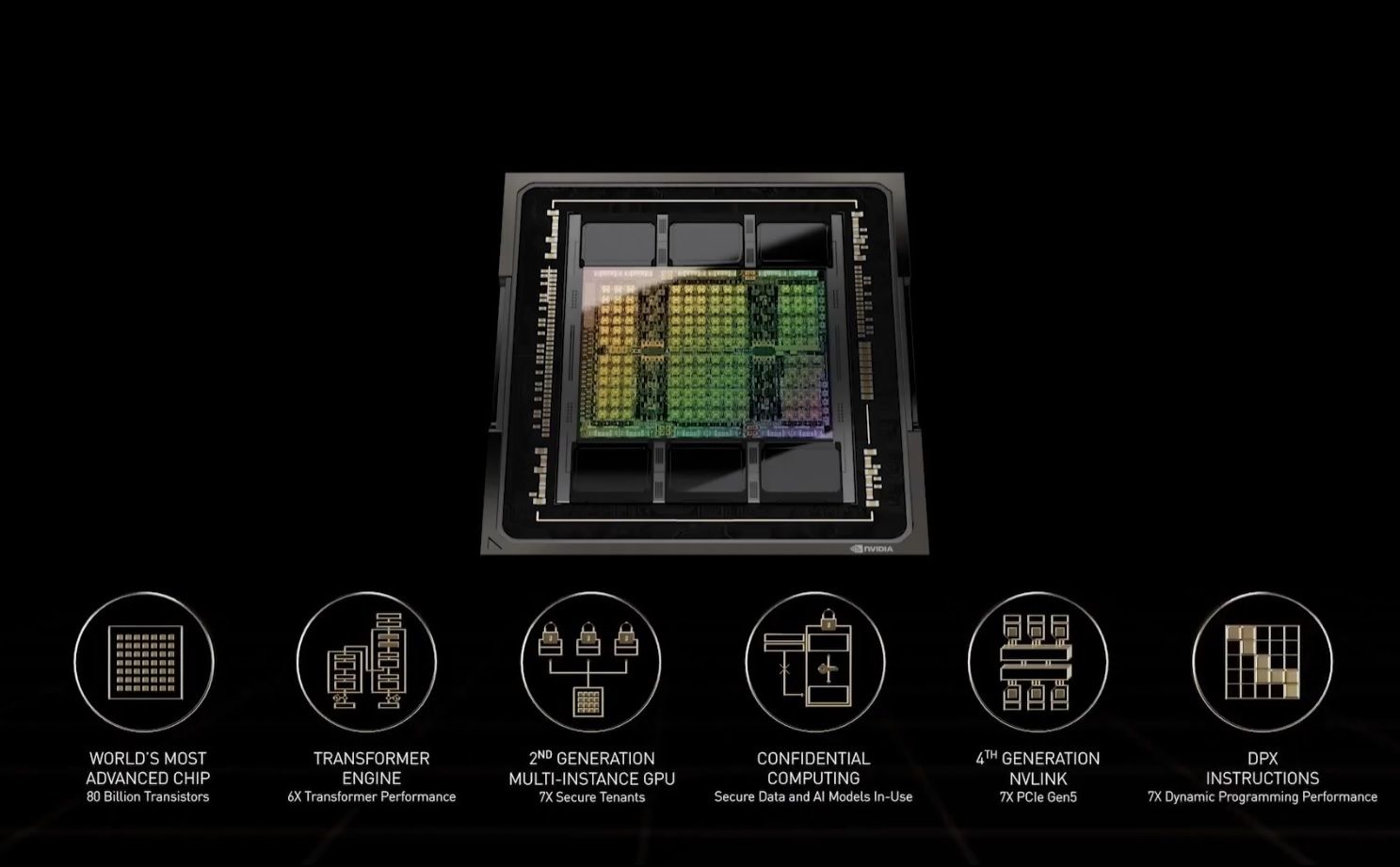

Outre la gravure plus fine et des optimisations internes, le nouveau composant profiter d'une interconnexion NVLink de 4ème génération et surtout de nouvelles instructions DPX (Dynamic Programming) qui va véritablement booster les performances dans de nombreux scénarios, de la modélisation (notamment dans le domaine de la biologie et de la génomique) à la robotique en passant par l'informatique quantique et le Big Data.

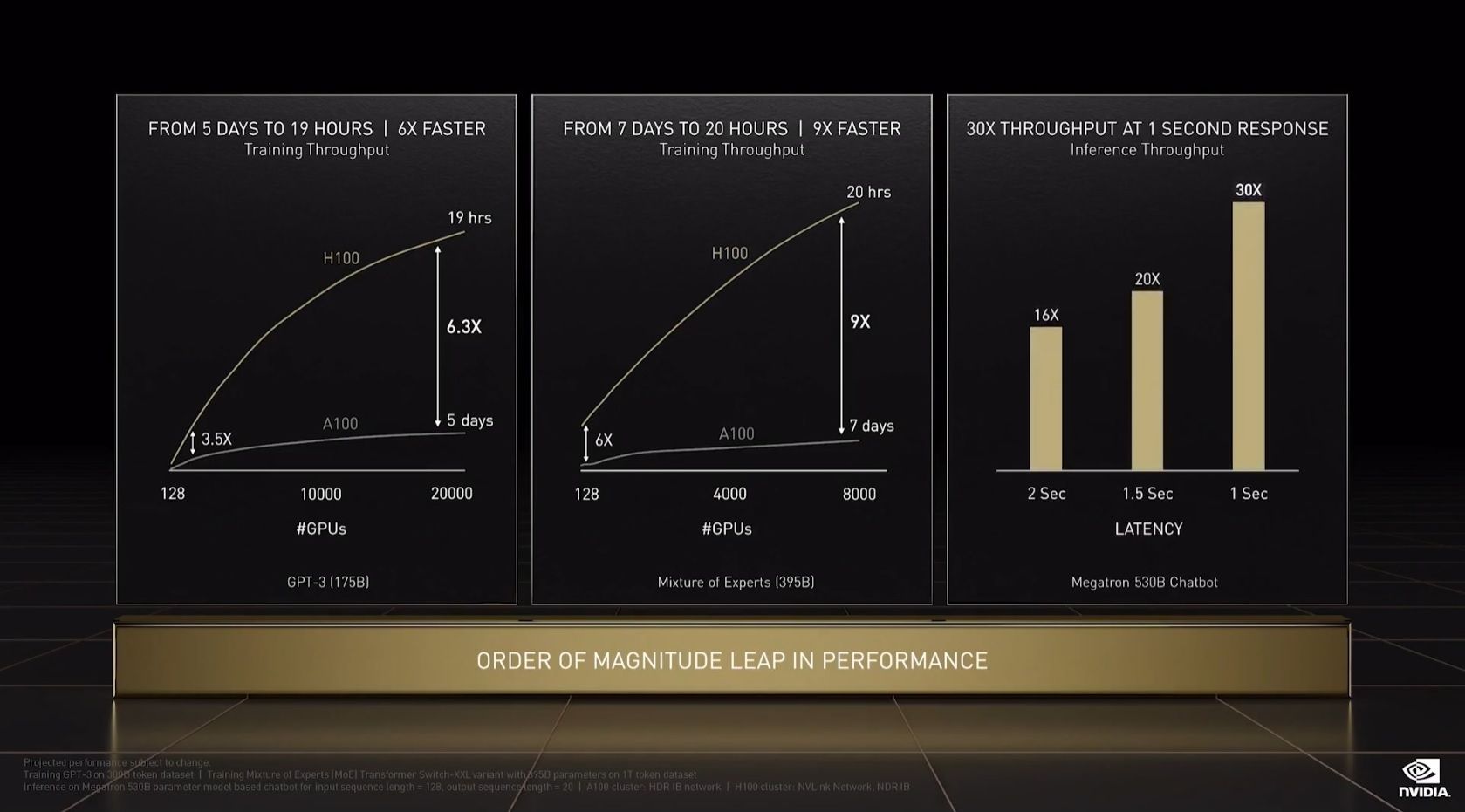

Ces nouvelles instructions vont permettre de multiplier par 7 les vitesses de traitement des algorithmes avec le nouveau Nvidia H100 par rapport au GPU Ampere et plus encore avec plusieurs GPU H100 interconnectés.

L'accélérateur Nvidia H100 supporte l'interface PCIe Gen 5 et exploitera de la mémoire rapide HBM3 assurant jusqu'à 3 To/s de bande passante. Le lien NVLink va permettre de créer des ensembles d'accélérateurs reposant sur le GPU Nvidia H100 capables de traiter de très gros volumes de données, notamment pour l'entraînement des intelligences artificielles.

Nvidia n'oublie pas la sécurité avec une architecture protégeant les données et les modèles d'IA passant par le GPU H100, un aspect particulièrement sensible pour certains secteurs comme la santé ou la banque.

On retrouvera le GPU H100 Hopper dans différents systèmes répondant à des besoins allant du serveur aux datacenters. La production a déjà démarré et les premières livraisons de GPU Hopper débuteront au troisième trimestre 2022.