L'incendie s'est propagé à la vitesse de l'éclair sur les réseaux sociaux. Des milliers d'internautes, paniqués à l'idée que leurs conversations intimes servent de carburant à une intelligence artificielle vorace, ont menacé de fermer leur compte.

Tout est parti d'une interprétation hâtive des conditions d'utilisation concernant les fonctionnalités intelligentes. Pourtant, la réalité technique est bien moins dystopique qu'il n'y paraît, même si la vigilance reste de mise quand on parle de données personnelles.

La confusion autour des "Smart Features"

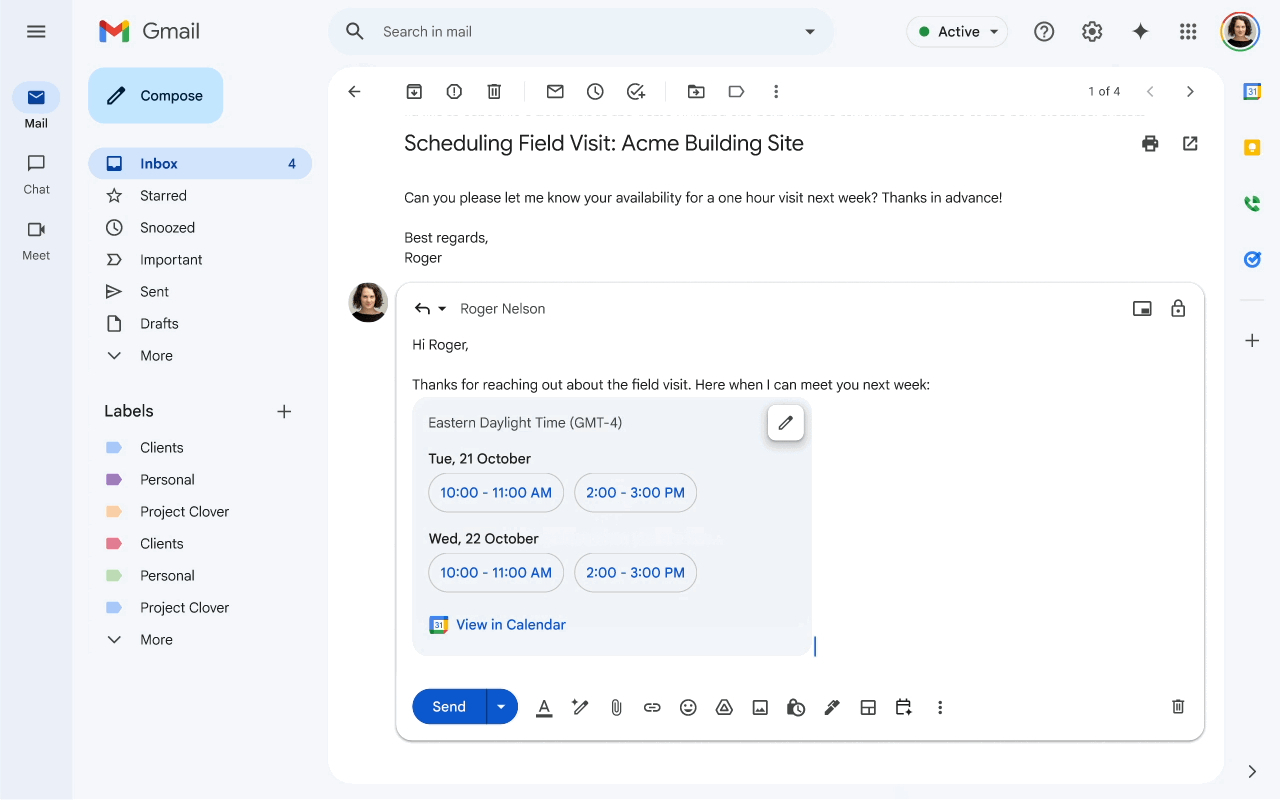

Au cœur de cette tempête numérique, on trouve un quiproquo classique entre service rendu et exploitation de données. Les utilisateurs ont redécouvert l'existence des "fonctions intelligentes" de Gmail. Vous savez, ces petits outils bien pratiques qui filtrent automatiquement vos spams, suggèrent des réponses rapides ou trient votre courrier en catégories.

IMPORTANT message for everyone using Gmail.

— Dave Jones (@eevblog) November 19, 2025

You have been automatically OPTED IN to allow Gmail to access all your private messages & attachments to train AI models.

You have to manually turn off Smart Features in the Setting menu in TWO locations.

Retweet so every is aware. pic.twitter.com/54FKcr4jO2

Pour fonctionner, ces algorithmes doivent techniquement "lire" les messages. C'est un fait. Cependant, les détracteurs ont fait un raccourci rapide en affirmant que cette lecture alimentait directement l'apprentissage des modèles génératifs. Or, activer le correcteur orthographique ne signifie pas que vous offrez votre correspondance à la science.

Le démenti ferme de Mountain View

Face à la grogne montante et à un début de recours collectif en Californie, le géant américain n'a pas eu d'autre choix que de sortir du bois. La communication est on ne peut plus claire : les données de Workspace restent dans Workspace. Un porte-parole de Google a formellement indiqué que le contenu des e-mails n'est jamais utilisé pour l'entraînement du modèle Gemini.

Il existe une nuance de taille entre un traitement local pour vous afficher un rappel de vol et l'ingestion massive de données pour rendre un chatbot plus performant. La firme insiste sur le fait que ces deux processus sont totalement cloisonnés, tentant ainsi de rassurer une base d'utilisateurs de plus en plus méfiante envers les géants de la Tech.

Garder le contrôle sur ses données

Si la confiance n'est pas votre fort, il reste possible de tout verrouiller. Les paramètres de confidentialité permettent de désactiver ces analyses automatisées. Le revers de la médaille ? Vous retournez à une expérience e-mail basique, sans tri intelligent ni aide à la rédaction. C'est le prix à payer pour une tranquillité d'esprit absolue face à l'essor de l'IA.

Cette affaire souligne surtout notre sensibilité accrue aux conditions d'utilisation que nous validons souvent sans lire. Même si l'entraînement est exclu, le simple fait qu'un algorithme accède à nos écrits suffit désormais à provoquer des sueurs froides, signe d'une époque où la "gratuité" des services est de plus en plus questionnée.

Foire Aux Questions (FAQ)

Est-ce que Google utilise mes mails pour l'IA ?

Non, Google a officiellement démenti cette rumeur. Le contenu de Gmail n'est pas utilisé pour entraîner les modèles génératifs comme Gemini, mais seulement analysé par des algorithmes pour des fonctions pratiques (anti-spam, réponses suggérées).

Comment désactiver l'analyse de mes e-mails ?

Il suffit de se rendre dans les paramètres de Gmail, section "Général", et de décocher les options relatives aux "Fonctions intelligentes et personnalisation". Attention, cela désactivera aussi le tri automatique et les suggestions.

Pourquoi cette rumeur est-elle devenue virale ?

Elle provient d'une confusion entre l'analyse nécessaire aux outils d'aide à la rédaction (Smart Features) et l'entraînement des modèles d'intelligence artificielle, amplifiée par la méfiance générale envers la gestion des données privées.

Mise à jour du 24/11/25 11h36 : Google a réagit en indiquant que "Ces informations sont trompeuses – nous n'avons modifié les paramètres d'aucun utilisateur, les fonctionnalités intelligentes de Gmail existent depuis de nombreuses années, et nous n'utilisons pas le contenu de votre Gmail pour entraîner notre modèle d'IA Gemini. Enfin, nous sommes toujours transparents et clairs si nous apportons des modifications à nos conditions d'utilisation et à nos politiques."