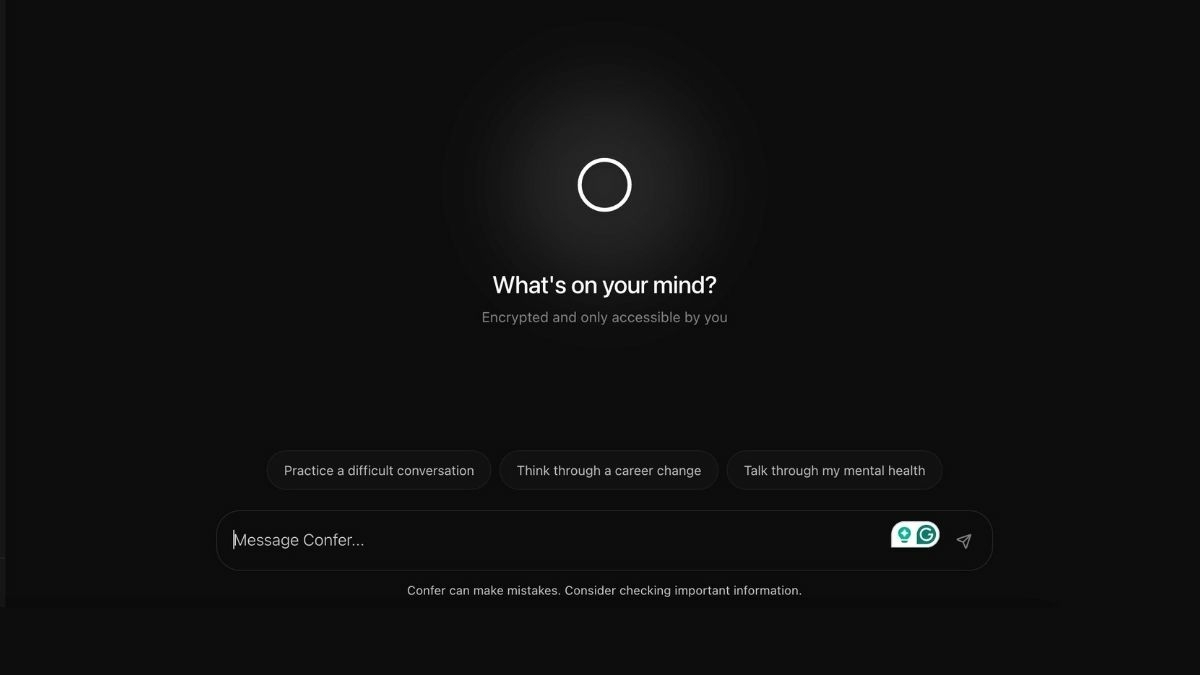

Dans un paysage numérique où les assistants IA comme ChatGPT ou Gemini centralisent massivement les données personnelles, un nouvel acteur entend changer les règles. Moxie Marlinspike, l'ingénieur à l'origine du protocole de chiffrement de Signal, dévoile Confer. Ce projet open source vise à appliquer les mêmes principes de sécurité absolue à l'intelligence artificielle, en créant un chatbot dont les échanges sont structurellement illisibles pour des tiers.

Comment Confer assure-t-il une protection technique des données ?

La philosophie de Confer est simple : la protection de la vie privée ne doit pas être une politique d'entreprise, mais une propriété technique démontrable. Le cœur du système repose sur un protocole de confidentialité stricte où les messages de l'utilisateur sont chiffrés directement sur son appareil avant même d'être envoyés aux serveurs. Les réponses générées par le modèle suivent le même chemin, étant chiffrées avant de quitter l'infrastructure de Confer.

Moxie Marlinspike

Concrètement, la clé permettant de lire les conversations est stockée uniquement sur le terminal de l'utilisateur. Les serveurs ne la détiennent jamais. Même si les discussions sont sauvegardées pour être synchronisées entre plusieurs appareils, elles le sont sous une forme chiffrée. Ainsi, une compromission des serveurs ou une réquisition judiciaire ne permettrait d'obtenir que des données totalement illisibles.

Quelle est l'architecture de sécurité derrière le service ?

Pour qu'un modèle de langage puisse répondre, il doit à un moment ou à un autre traiter la requête en clair. Confer résout ce paradoxe grâce à l'usage de Trusted Execution Environments (TEE). Il s'agit d'une zone ultra-sécurisée et isolée au sein même du processeur des serveurs. Les données y sont déchiffrées, traitées par l'IA, puis la réponse est de nouveau chiffrée avant de quitter cette enclave, rendant le processus opaque même pour les administrateurs système.

L'ensemble est renforcé par un mécanisme de remote attestation, qui permet de vérifier que les serveurs exécutent bien le code open source publié, sans modification. Le système d'authentification, lui, abandonne les mots de passe au profit des chiffrement via clés d'accès, un standard sécurisé où la clé privée ne quitte jamais l'appareil de l'utilisateur.

Pourquoi un tel projet est-il devenu nécessaire ?

L'initiative de Moxie Marlinspike répond à une inquiétude croissante face à la centralisation des données par les géants de la tech. Il anticipe l'arrivée imminente de la publicité ciblée au cœur des assistants IA, qui posséderont une connaissance intime du contexte et des préoccupations de leurs utilisateurs. Il décrit ce futur comme « un tiers payant votre thérapeute pour vous convaincre de quelque chose ».

Cette approche rompt avec le modèle dominant où, même lorsque l'entraînement des modèles sur les conversations est désactivé, les données restent techniquement accessibles à l'opérateur. L'utilisation des passkeys renforce cette approche « zéro confiance ». Des affaires, comme l'ordonnance judiciaire forçant OpenAI à conserver indéfiniment les conversations, ont montré les limites des promesses de confidentialité basées uniquement sur la confiance.